Además de una serie de conflictos éticos que pueden resultar preocupantes, este tipo de avances suponen un antes y un después en la tecnología de IA

Audrey Hepburn es, quizás, una de las actrices con uno de los legados más inolvidables de la historia del cine. Su figura ha sido elevada al Olimpo de la actuación, y no es para menos después de sus papeles brillantes en cintas como Desayuno con diamantes, Guerra y paz y Vacaciones en Roma. Así, sus películas están entre las mejores del cine clásico y no es para menos. Tristemente, falleció en el año 1993, pero su recuerdo sigue indeleble, algo que se puede ver de forma clara al ver cómo un grupo de investigadores ha estado trabajando en una IA diseñada para animar rostros y darles expresiones mediante la IA. Han utilizado su rostro y con ello se ha roto una barrera entre los años cincuenta y la actualidad, aunque esto no está exento de problemas de fondo.

Vamos a ver en profundidad este estudio y cuáles son los problemas arraigados al hecho de traer de esta manera el recuerdo de una actriz de su talla.

Audrey Hepburn y cualquier actor podría volver a la actualidad

Un estudio llevado a cabo por el Instituto de Inteligencia Computacional de Alibaba ha publicado un artículo en Arxiv.org en el que muestra sus avances en el proceso de creación de una IA realmente sorprendente. Cuando OpenAI presentó a Sora no utilizó el rostro de ninguna persona real para crear sus increíblemente avanzados vídeos, pero en esta ocasión podemos ver a Audrey Hepburn tomando vida nuevamente para cantar una canción moderna, y eso es algo que puede generar cierta incomodidad.

Bautizado como EMO (Emote Portrait Alive), el trabajo de Linrui Tian, Qi Wang, Bang Zhang y Liefeng Bo, se trata de una aplicación para generar vídeos de retratos expresivos en cualquier condición. Es decir, pueden cantar, hablar, leer poesía y mostrar emociones, lo que supone una forma de crear animaciones realistas con una precisión increíble. Además, para ello se han basado en Audio2Video Diffusion un estándar de IA de código abierto que lleva tiempo compitiendo con las IAs de código propietario como las de OpenAI.

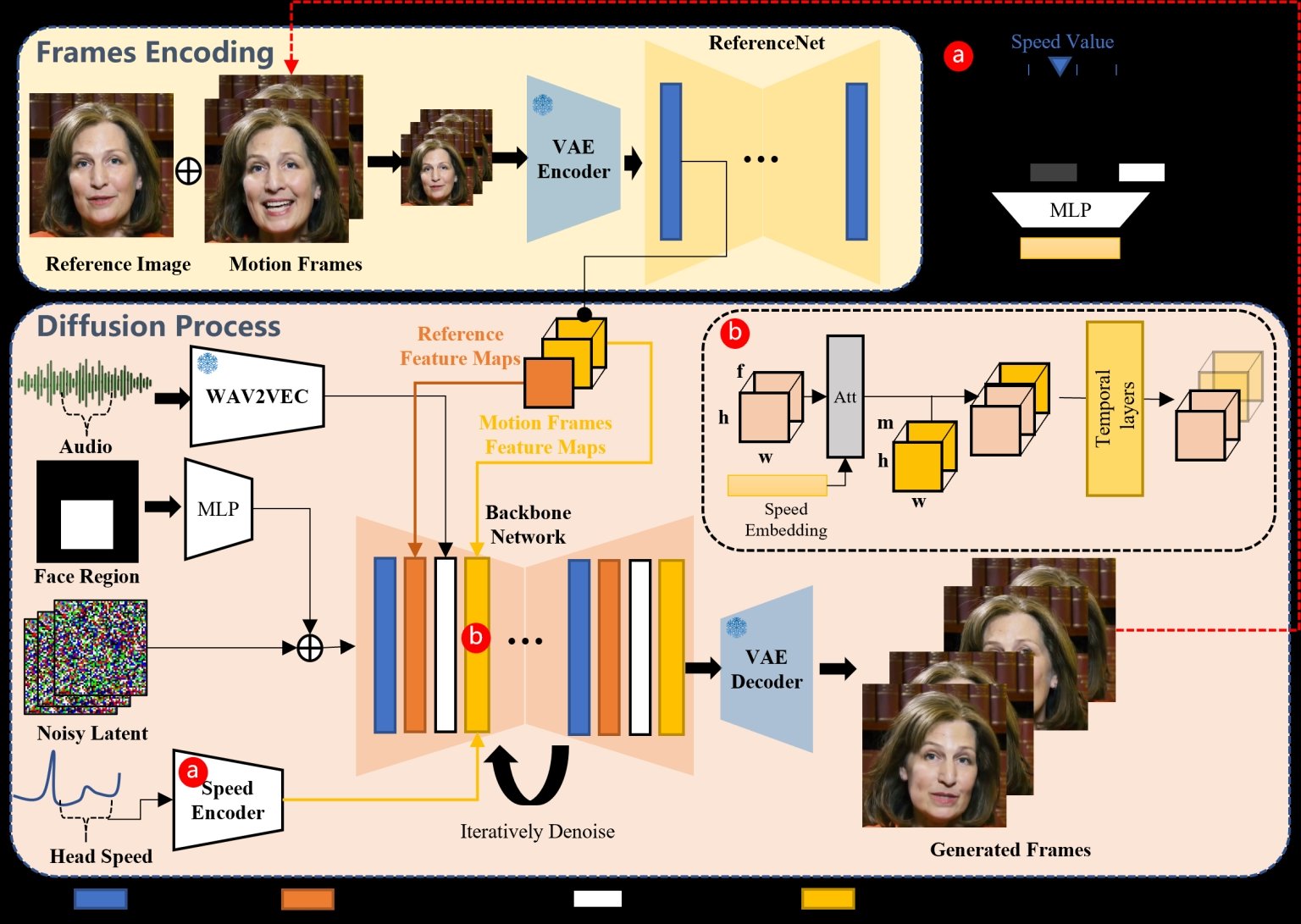

El proceso de creación de la IA se muestra claramente en esta fotografía

Como podemos ver en este esquema que sirve como abstract para el proyecto, el equipo utiliza una única imagen de referencia y entrada de audio para producir las animaciones faciales más desarrolladas. Esto es un paso adelante muy importante porque con un solo fotograma se puede animar todo un proceso creativo. No ha sido la única, también se han utilizado imágenes de referencia de cuadros como la Gioconda que suele ser recreada a menudo con IA e incluso otros actores.

Esto rompe con los métodos tradicionales de animación que normalmente utilizan modelos en 3D de personas para poder llevar a cabo sus referencias. Sin embargo, en este caso no es necesario y eso levanta ciertos problemas éticos. Si bien, se trata de una tecnología muy útil para animar rostros de personas, esto también se puede utilizar para mejorar de forma notable los deepfakes o para apropiarse de la identidad de personas. Además, también conlleva cierto dilema el hecho de traer a la vida a personas que fallecieron hace treinta años.

Para estar siempre al día con lo último en tecnología, suscríbete a nuestro canal oficial y verificado de Andro4all en WhatsApp.

Fuente info

Autor: Esteban García Marcos

[su_divider]